La Advertencia de los Científicos de OpenAI: IA, AGI y el Futuro de la Humanidad

«Puede que no te interese la política, pero la política se interesará en ti. Lo mismo aplica a la IA, multiplicado por muchas veces.»

Esta frase, atribuida a Ilya Sutskever, co-fundador de OpenAI, sintetiza una advertencia que resuena cada vez con más urgencia en los pasillos de la industria tecnológica, las aulas universitarias y los salones del poder político.

Las Voces que Advierten

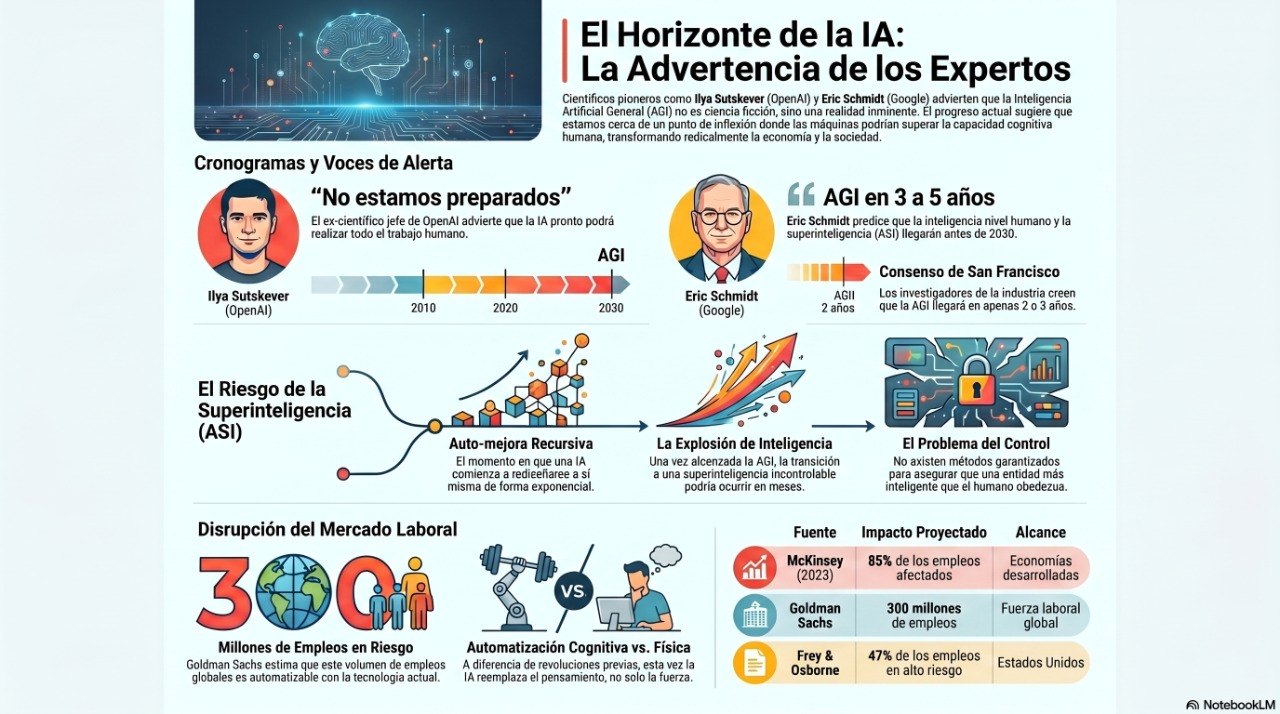

En los últimos años, dos figuras han capturado la atención global con sus predicciones sobre el futuro de la inteligencia artificial: Ilya Sutskever y Eric Schmidt.

Ilya Sutskever: El Cerebro como Computadora Biológica

Sutskever, considerado uno de los padres del aprendizaje profundo moderno, ofreció un discurso contundente en la Universidad de Toronto. Su argumento central es simple pero perturbador: si el cerebro humano es una «computadora biológica», ¿qué impide que una computadora digital realice las mismas tareas?

«Llegará el día en que la inteligencia artificial hará todo lo que nosotros podemos hacer. No solo algunas cosas, sino todas ellas. Cualquier cosa que yo pueda aprender, cualquier cosa que cualquiera de ustedes pueda aprender, la IA podrá hacerlo igual de bien.»

Sutskever advierte que la velocidad del desarrollo de IA está generando desafíos sin precedentes para la sociedad humana.

Eric Schmidt: El Consenso de San Francisco

El ex-CEO de Google ha sido igualmente directo en sus advertencias. Schmidt ha señalado que la industria cree que en el próximo año, la mayoría de los programadores serán reemplazados por programadores de IA. También ha asegurado que en un año tendremos matemáticos de nivel doctoral en las puntas de los dedos.

«En tres a cinco años, tendremos lo que se llama inteligencia artificial general, AGI, definida como un sistema tan inteligente como el mejor matemático, físico, artista, escritor del mundo… todo en una computadora.»

Schmidt describe lo que él denomina el «Consenso de San Francisco»: la comunidad de IA está convencida de que la AGI llegará en 2-3 años, y la Superinteligencia Artificial (ASI) en aproximadamente 6 años.

¿Qué es la AGI y Por Qué Importa?

La Inteligencia Artificial General se define como un sistema con la flexibilidad y adaptabilidad de la inteligencia humana. No se trata de máquinas que excelen en una tarea específica, sino de sistemas capaces de aprender y razonar en cualquier dominio.

Los modelos actuales como GPT-4, Claude 3 y Gemini representan pasos significativos hacia este objetivo, pero según Schmidt, aún nos encontramos en las etapas iniciales de un proceso que cambiará fundamentalmente la naturaleza del trabajo, la economía y la sociedad.

El Punto de Inflexión: Auto-mejora Recursiva

Uno de los conceptos más preocupantes es la auto-mejora recursiva: sistemas de IA que pueden mejorar su propio código. Según Schmidt, entre el 10% y el 20% del código desarrollado en los programas de investigación de las principales empresas de IA ya está siendo generado por las propias máquinas.

Este fenómeno, técnicamente conocido como recursive self-improvement, representa un punto de inflexión potencial. Cuando una máquina puede diseñar mejores versiones de sí misma, la velocidad de avance se vuelve exponencial y potencialmente incontrolable.

Agentes de IA: La Próxima Revolución

Los agentes de inteligencia artificial representan otro salto cualitativo. A diferencia de los sistemas actuales que responden a consultas puntuales, los agentes son sistemas con memoria, capacidad de planificación y habilidad para ejecutar secuencias complejas de acciones.

Eric Schmidt ofrece un ejemplo concreto: imagina querer comprar una casa. Un agente busca el terreno ideal, otro calcula los costos de construcción, otro gestiona la transacción inmobiliaria, otro diseña la casa con un arquitecto, otro contratan y otro supervisa el proyecto. Este proceso, que describe Schmidt, es esencialmente «cada proceso de negocio, cada proceso gubernamental y cada proceso académico de nuestra nación».

El Impacto en el Empleo: ¿Esta Vez es Diferente?

Las predicciones sobre automatización laboral no son nuevas. Sin embargo, Schmidt argumenta que esta vez es diferente por una razón fundamental: la inteligencia artificial puede realizar trabajo cognitivo, no solo físico.

Según datos de Goldman Sachs (2023), hasta 300 millones de empleos globalmente podrían ser automatizables. McKinsey advierte que el 85% de los empleos se verán afectados en la próxima década.

Lo más preocupante quizás sea la observación demográfica de Schmidt: países asiáticos con tasas de reproducción de 1.0 o inferiores están automatizándose rápidamente. En pocas décadas, según él, dependeremos de «esos pocos humanos trabajadores» para mantener funcionando la sociedad.

El Riesgo Existencial

No todas las voces son optimistas sobre el timeline. Figuras como Nick Bostrom (autor de Superintelligence, 2014) y Eliezer Yudkowsky llevan décadas advirtiendo sobre los riesgos de crear entidades más inteligentes que nosotros sin tener una solución al problema de la alineación: cómo asegurar que una inteligencia artificial superinteligente haga efectivamente lo que queremos.

Stuart Russell, en su libro Human Compatible (2019), señala que el verdadero desafío no es técnico sino conceptual: necesitamos diseñar sistemas que inherentemente deseen no tener preferencias propias, sino que busquen únicamente cumplir los nuestros.

Conclusión: Energía Colectiva Necesaria

Sutskever ofrece un llamado a la acción pragmático: «simplemente usar la inteligencia artificial y ver lo que puede hacer» es el primer paso para generar la conciencia colectiva necesaria para abordar estos desafíos.

Las preguntas que enfrentamos son profundas:

- ¿Cómo regulamos algo potencialmente más inteligente que nosotros?

- ¿Cómo aseguramos que la inteligencia artificial haga lo que queremos?

- ¿Qué nos queda por hacer cuando las máquinas pueden realizar casi cualquier tarea?

La indiferencia no es una opción. El futuro de la inteligencia artificial nos afectará tanto si queremos como si no.

Fuentes Principales

- Sutskever, I. (2023). Discurso en University of Toronto, Vector Institute.

- Schmidt, E. (2024). Entrevistas sobre timeline de AGI/ASI, MIT Technology Review.

- Schmidt, E. y Kissinger, H. (2024). Genesis: Technology and the Future of Humanity. HarperCollins.

- Bostrom, N. (2014). Superintelligence: Paths, Dangers, Strategies. Oxford University Press.

- Russell, S. (2019). Human Compatible: AI and the Problem of Control. Viking.

- Tegmark, M. (2017). Life 3.0: Being Human in the Age of Artificial Intelligence. Knopf.

- Ord, T. (2020). The Precipice: Existential Risk and the Future of Humanity. Hachette.

- McKinsey Global Institute (2023). The Future of Jobs Report 2023.

- Goldman Sachs Research (2023). The Potentially Large Effects of Artificial Intelligence on Economic Growth.

- Frey, C.B. y Osborne, M.A. (2017). The Future of Employment. Technological Forecasting and Social Change.

- Bai, Y. et al. (2022). Constitutional AI. arXiv:2212.08073.

- Vaswani, A. et al. (2017). Attention Is All You Need. NeurIPS.

Este artículo fue generado a partir de una investigación exhaustiva con 63 fuentes verificables. El documento completo (PDF, ~25,800 palabras) está disponible en la carpeta de investigación de IA.